【要約】

HQ-SAMは、既存のSAM(Segment Anything Model)を拡張し、高精度なゼロショットセグメンテーションを実現する。SAMはプロンプトを用いてオブジェクトのセグメンテーションを行うものである。HQ-SAMはSAMを拡張し、高品質なセグメンテーションを可能にするために新しいアプローチを採用している。この手法はWindows上で実行できる。インストールと使用手順とPythonプログラムは公式ページで提供されている、このページでは,インストールと使用手順の説明に加えて、学習済みモデルを使用してセグメンテーションマスクを生成するPythonプログラムも示している.

【目次】

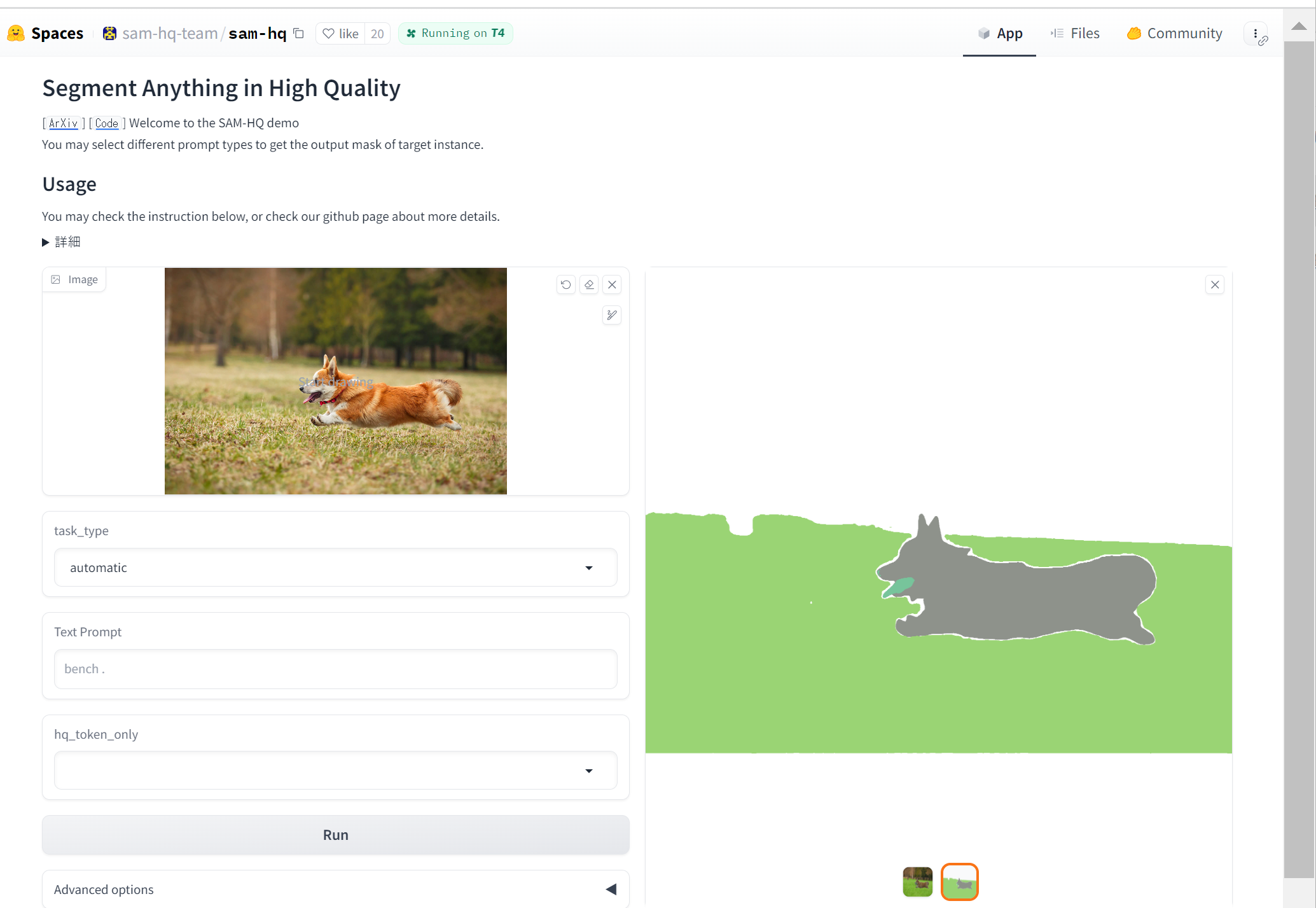

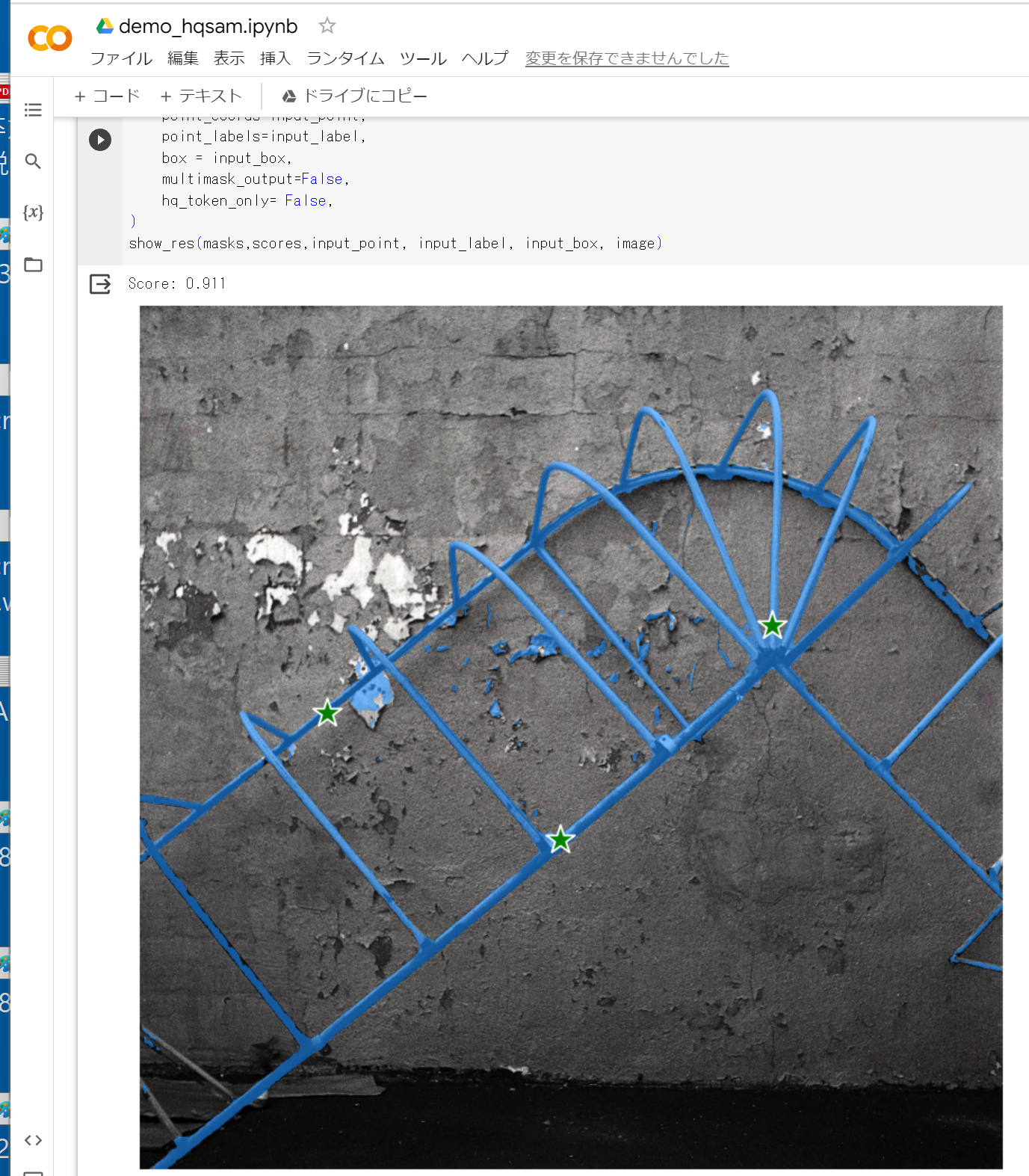

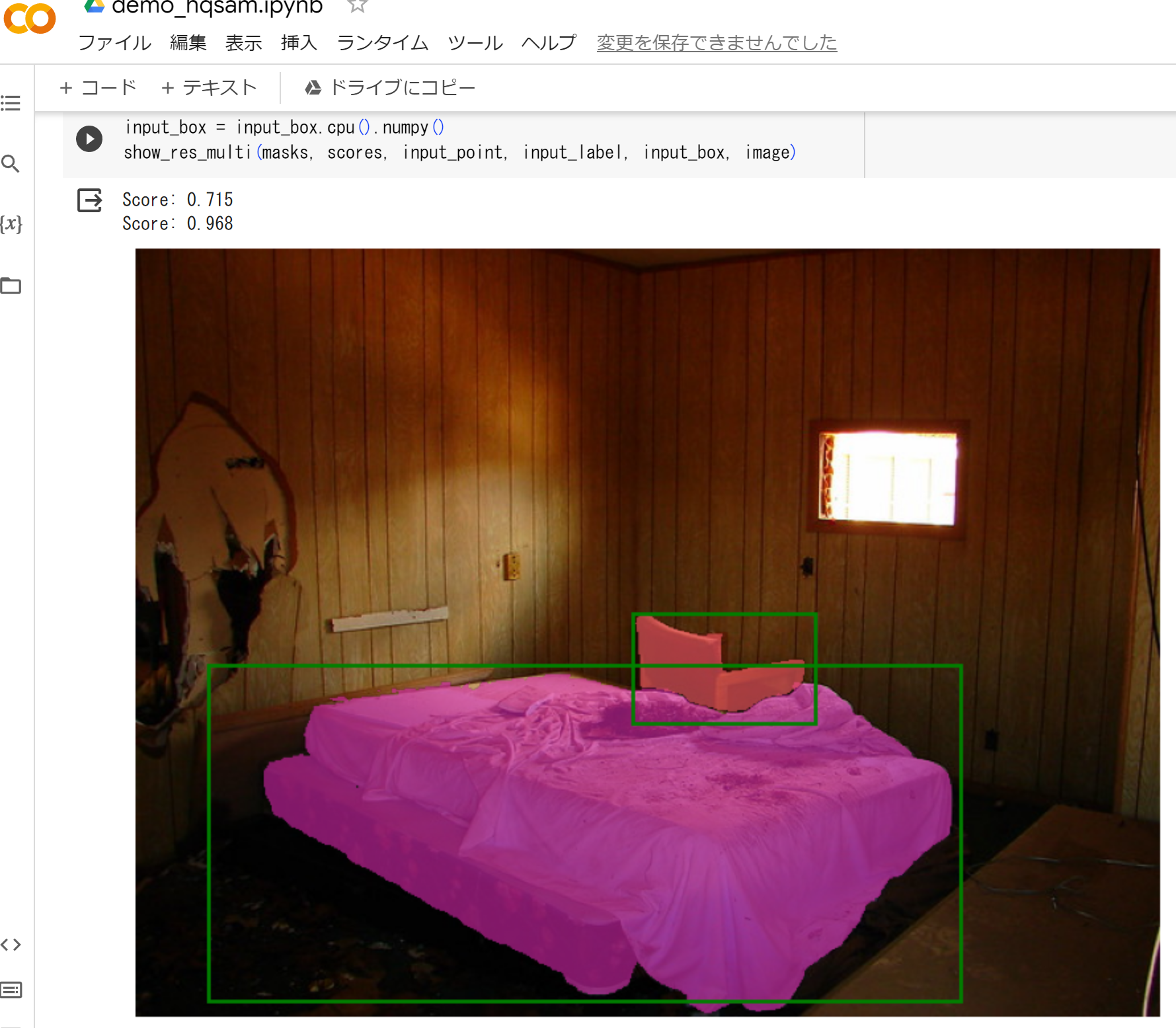

元画像と,生成されたセグメンテーションマスク

HQ-SAMは、既存のSAM(Segment Anything Model)を拡張し、より高精度なゼロショットセグメンテーションを実現する手法である。SAMは、プロンプト(点、バウンディングボックス、粗いマスクなど)を入力として、多様なオブジェクトや視覚構造のセグメンテーションを可能にするモデルである。しかし、SAMは細かい構造を持つオブジェクトに対するセグメンテーションが不十分で、その精度に限界がある。この問題を解決するために、HQ-SAMはSAMを拡張している。HQ-SAMでは、SAMのマスクデコーダに新しい学習可能な「HQ-Output Token」を導入している。さらに、グローバルなセマンティックコンテキストとローカルな境界(バウンダリ)の詳細を両方考慮する「Global-local Feature Fusion」も導入されている。複数のデータセットでの実験により、HQ-SAMが高精度なセグメンテーションマスクを生成できることが確認されている。

【文献】 Ke, Lei and Ye, Mingqiao and Danelljan, Martin and Liu, Yifan and Tai, Yu-Wing and Tang, Chi-Keung and Yu, Fisher, Segment Anything in High Quality, arXiv:2306.01567, 2023.

https://arxiv.org/pdf/2306.01567v1.pdf

【関連する外部ページ】

【関連項目】 SAM (Segment Anything Model)

Gitは,バージョン管理システム.ソースコードの管理や複数人での共同に役立つ.

【サイト内の関連ページ】

Windows での Git のインストール: 別ページ »で説明している.

【関連する外部ページ】

Git の公式ページ: https://git-scm.com/

【サイト内の関連ページ】

【関連する外部ページ】

Python の公式ページ: https://www.python.org/

【サイト内の関連ページ】

NVIDIA グラフィックスボードを搭載しているパソコンの場合には, NVIDIA ドライバ, NVIDIA CUDA ツールキット, NVIDIA cuDNN のインストールを行う.

【関連する外部ページ】

コマンドプロンプトを管理者として実行: 別ページ »で説明

PyTorch のページ: https://pytorch.org/index.html

次のコマンドは, PyTorch 2.0 (NVIDIA CUDA 11.8 用) をインストールする. 但し,Anaconda3を使いたい場合には別手順になる.

事前に NVIDIA CUDA のバージョンを確認しておくこと(ここでは,NVIDIA CUDA ツールキット 11.8 が前もってインストール済みであるとする).

PyTorch で,GPU が動作している場合には,「torch.cuda.is_available()」により,True が表示される.

python -m pip install -U --ignore-installed pip python -m pip install -U torch torchvision torchaudio numpy --index-url https://download.pytorch.org/whl/cu118 python -c "import torch; print(torch.__version__, torch.cuda.is_available())"

![[image]](../../tools/man/529.png)

Anaconda3を使いたい場合には, Anaconda プロンプト (Anaconda Prompt) を管理者として実行し, 次のコマンドを実行する. (PyTorch と NVIDIA CUDA との連携がうまくいかない可能性があるため,Anaconda3を使わないことも検討して欲しい).

conda install -y pytorch torchvision torchaudio pytorch-cuda=11.8 cudnn -c pytorch -c nvidia py -c "import torch; print(torch.__version__, torch.cuda.is_available())"

【サイト内の関連ページ】

【関連する外部ページ】

公式の GitHub ページ: https://github.com/SysCV/sam-hq の記載に従う.

コマンドプロンプトを管理者として実行: 別ページ »で説明

cd %HOMEPATH% rmdir /s /q sam-hq git clone --recursive https://github.com/syscv/sam-hq cd sam-hq python -m pip install -e . python -m pip install -U opencv-python pycocotools matplotlib onnxruntime onnx gdown mkdir pretrained_checkpoint

エラーメッセージが出ていないこと.

![[image]](../../ai/win/590.png)

学習済みモデルは,公式ページ https://github.com/SysCV/sam-hq で公開されている.

![[image]](../../ai/win/591.png)

次のコマンドを実行することにより, 公式ページで公開されている学習済みモデル vit_b: ViT-B HQ-SAM model, vit_l: ViT-L HQ-SAM model, vit_h: ViT-H HQ-SAM model, vit_tiny (Light HQ-SAM for real-time need): ViT-Tiny HQ-SAM model をダウンロードする.

cd %HOMEPATH%\sam-hq cd pretrained_checkpoint curl -L -O https://huggingface.co/lkeab/hq-sam/resolve/main/sam_hq_vit_b.pth curl -L -O https://huggingface.co/lkeab/hq-sam/resolve/main/sam_hq_vit_l.pth curl -L -O https://huggingface.co/lkeab/hq-sam/resolve/main/sam_hq_vit_h.pth curl -L -O https://huggingface.co/lkeab/hq-sam/resolve/main/sam_hq_vit_tiny.pth

![[image]](../../ai/win/592.png)

cd %HOMEPATH%\sam-hq python -m pip install -U timm python demo\demo_hqsam.py

![[image]](../../ai/win/593.png)

元画像の画像ファイルは,demo\input_imgs にある

![[image]](../../ai/win/594.png)

結果の画像ファイルは,demo\hq_sam_result にある

![[image]](../../ai/win/595.png)

実行時にファイルを選択する.ファイルは複数選択可能である.

cd %HOMEPATH%\sam-hq notepad segment.py

このプログラムは,公式の Sement Anything のページで公開されていたものを参考に作成.

from segment_anything import SamAutomaticMaskGenerator, sam_model_registry

sam_checkpoint = "./pretrained_checkpoint/sam_hq_vit_h.pth"

model_type = "vit_h" #"vit_l/vit_b/vit_h/vit_tiny"

device = "cuda"

sam = sam_model_registry[model_type](checkpoint=sam_checkpoint)

sam.to(device=device)

mask_generator = SamAutomaticMaskGenerator(sam)

import numpy as np

import torch

import matplotlib.pyplot as plt

import cv2

import tkinter as tk

from tkinter import filedialog

root = tk.Tk()

root.withdraw()

fpaths = filedialog.askopenfilenames()

def show_anns(anns):

if len(anns) == 0:

return

sorted_anns = sorted(anns, key=(lambda x: x['area']), reverse=True)

ax = plt.gca()

ax.set_autoscale_on(False)

img = np.ones((sorted_anns[0]['segmentation'].shape[0], sorted_anns[0]['segmentation'].shape[1], 4))

img[:,:,3] = 0

for ann in sorted_anns:

m = ann['segmentation']

color_mask = np.concatenate([np.random.random(3), [0.35]])

img[m] = color_mask

ax.imshow(img)

i = 0

for fpath in root.tk.splitlist(fpaths):

print("file name: ", fpath)

bgr = cv2.imread(fpath)

rgb = cv2.cvtColor(bgr, cv2.COLOR_BGR2RGB)

plt.figure(figsize=(20,20))

plt.imshow(rgb)

plt.axis('off')

plt.show()

masks = mask_generator.generate(rgb)

plt.figure(figsize=(20,20))

plt.imshow(rgb)

show_anns(masks)

plt.axis('off')

plt.savefig(str(i)+".png", bbox_inches='tight', pad_inches=0, transparent=True)

print(str(i)+".png"+" saved.")

plt.show()

plt.close() # グラフを閉じる

i = i + 1

![[image]](../../ai/win/601.png)

Python プログラムの実行

Python 開発環境(Jupyter Qt Console, Jupyter ノートブック (Jupyter Notebook), Jupyter Lab, Nteract, Spyder, PyCharm, PyScripterなど)も便利である.

Python のまとめ: 別ページ »にまとめ

プログラムを segment.pyのようなファイル名で保存したので, 「python segment.py」のようなコマンドで行う.

python segment.py

![[image]](../../ai/win/602.png)

![[image]](../../ai/win/603.png)

確認したら,右上の「x」をクリックする.右上の「x」をクリックするまでは,プログラム実行は中断している.

![[image]](../../ai/win/596.png)

確認したら,右上の「x」をクリックする.右上の「x」をクリックするまでは,プログラム実行は中断している.

![[image]](../../ai/win/598.png)

ファイル名は,0.png, 1.png, 2.png, ... のようになっている.

パソコンのビデオカメラで実行する.

cd %HOMEPATH%\sam-hq notepad vidcam.py

![[image]](../../ai/win/631.png)

このプログラムは,公式の Sement Anything のページで公開されていたものを参考に作成.

最も軽量である vit_tiny (Light HQ-SAM for real-time need): ViT-Tiny HQ-SAM model を使用.

from segment_anything import SamAutomaticMaskGenerator, sam_model_registry

import numpy as np

import torch

import matplotlib.pyplot as plt

import cv2

def main():

sam_checkpoint = "./pretrained_checkpoint/sam_hq_vit_tiny.pth"

model_type = "vit_tiny" #"vit_l/vit_b/vit_h/vit_tiny"

device = "cuda"

sam = sam_model_registry[model_type](checkpoint=sam_checkpoint)

sam.to(device=device)

mask_generator = SamAutomaticMaskGenerator(sam)

def get_anns(anns):

if len(anns) == 0:

return

sorted_anns = sorted(anns, key=(lambda x: x['area']), reverse=True)

ax = plt.gca()

ax.set_autoscale_on(False)

img = np.ones((sorted_anns[0]['segmentation'].shape[0], sorted_anns[0]['segmentation'].shape[1], 4))

img[:, :, 3] = 0

for ann in sorted_anns:

m = ann['segmentation']

color_mask = np.concatenate([np.random.random(3), [0.35]])

img[m] = color_mask

return img

print("Prease press q to exit")

cap = cv2.VideoCapture(0)

while (cap.isOpened()):

r, f = cap.read()

if (r == False):

print("Video Capture Error")

break

else:

cv2.imshow('Video Capture', f)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

masks = mask_generator.generate(f)

img = get_anns(masks)

cv2.imshow('SAM Result', img)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows()

if __name__ == "__main__":

main()

![[image]](../../ai/win/632.png)

Python プログラムの実行

Python 開発環境(Jupyter Qt Console, Jupyter ノートブック (Jupyter Notebook), Jupyter Lab, Nteract, Spyder, PyCharm, PyScripterなど)も便利である.

Python のまとめ: 別ページ »にまとめ

プログラムを vidcam.pyのようなファイル名で保存したので, 「python vidcam.py」のようなコマンドで行う.

python vidcam.py

![[image]](../../ai/win/633.png)

q キーで終了する.

![[image]](../../ai/win/634.png)

![[image]](../../ai/win/635.png)

使い方:「masks, scores, logits = predictor.predict()」の引数にプロンプトを設定.実行したらファイルを選択.画像を確認したら,画像をクリックした後,キーボードのキーをクリックして次に進む

import cv2

import numpy as np

from segment_anything import SamPredictor, sam_model_registry

sam_checkpoint = "./pretrained_checkpoint/sam_hq_vit_h.pth"

model_type = "vit_h"

device = "cuda"

sam = sam_model_registry[model_type](checkpoint=sam_checkpoint)

sam.to(device=device)

predictor = SamPredictor(sam)

import tkinter as tk

from tkinter import filedialog

root = tk.Tk()

root.withdraw()

fpaths = filedialog.askopenfilenames()

for fpath in root.tk.splitlist(fpaths):

print("file name: ", fpath)

bgr = cv2.imread(fpath)

rgb = cv2.cvtColor(bgr, cv2.COLOR_BGR2RGB)

cv2.imshow("1", rgb)

print("press a key to continue")

cv2.waitKey(0)

predictor.set_image(rgb)

masks, scores, logits = predictor.predict(

point_coords=None,

point_labels=None,

box = None,

multimask_output=False,

hq_token_only= False,

)

opencv_mat = cv2.cvtColor(masks[0].astype(np.uint8) * 255, cv2.COLOR_GRAY2BGR)

cv2.imshow("2", opencv_mat)

print("press a key to continue")

cv2.waitKey(0)

cv2.destroyAllWindows()